|

Quote:

Comunque, quando usate a fondo, GF1 e GF2 producevano grafica davvero bella. Qui per esempio trovate una prova con X-ISLE (il demo tecnologico di Crytek che sarebbe poi evoluto in FarCry ;)): http://ixbtlabs.com/articles/gf2hwtl/ Qualche altro screenshot di altri giochi:  e  Decisamente belli... Ciao. :) |

GeForce2 rulez... :O

|

Colin 2.0 con l'inarrivabile Cube Mapping

(nello screen gira su GF3 ma fu un effetto only GF2 all'uscita) |

Quote:

oggi sono via, domani o nei prossimi giorni provvedo in quanto a quegli screen, davvero niente male... sotto alcuni aspetti certi giochi di 10 anni fa non erano molto peggio di quelli di oggi come grafica... |

Quote:

|

bei screenshot :)

|

Quote:

Ciao. :) |

Quote:

Per lo step successivo però, più che l'HDR, metterei l'introduzione di valori floating point nelle pipeline di renderig. La differenza di qualità ottenibile passando da int a fp è per gran parte responsabile della maggiore qualità degli shader DX9 rispetto a quelli DX8. Ciao. :) |

Quote:

se non ricordo male anche alcuni giochi piu' vecchi (forse glide o opengl?) avevano una bella grafica Quote:

Quote:

siete dei mostri :ave: :ave: |

Quote:

|

Quote:

|

Quote:

Hai ragione anche tu, ma recentemente ho rigiocato ad Halo2 (su Xbox1), e la qualità degli shader mi è parsa superba: prova, inoltre, Half Life2 su una scheda DX 8.1 ed una DX9; la differenza c'è, ma non è di quelle da gridare al miracolo... quando passi ad un HDR fatto bene, invece, il tutto è assai palese. |

Quote:

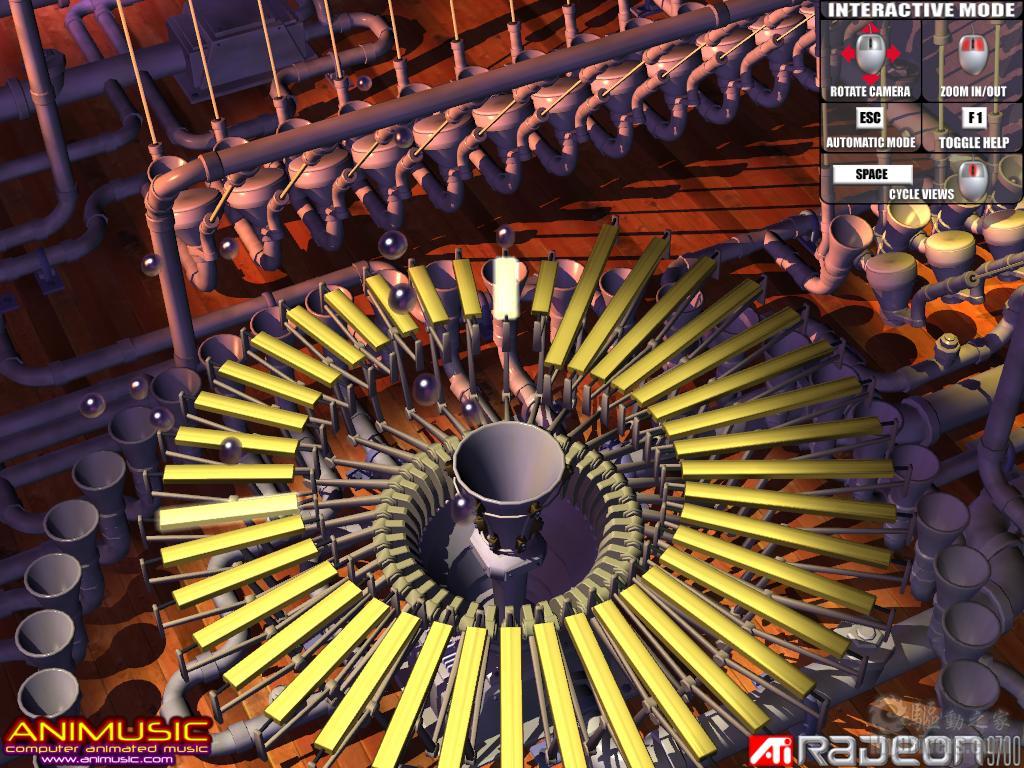

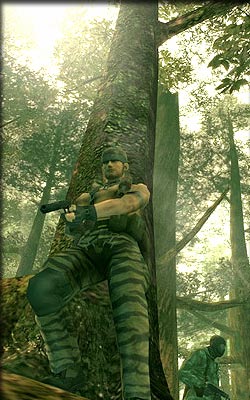

Quello che volevo mettere in evidenza, però, è che l'HDR non è altro che un "effetto collaterale" dell'estensione di precisione da int a fp. Grazie alla precisione fp, R300 poteva renderizzare scene come questa:  e questa:  Tra l'altro, il secondo demo (Animusic Pipe Dream) visto da vivo è sbalorditivo. :eek: Riguardo agli shader applicati nei giochi, considera che fino al 2004 spesso i giochi erano pensati principalmente per le DX8 e quindi non traevano enormi vantaggi dalle capacità estese fornite dalle DX9... Ciao. :) |

Quote:

|

Quote:

Per capirci, pensa al rendering classico a 32 bit (8 bit per canale RGBA): con questo hai 16777216 colori a disposizione. Hai bisogno di _più_ colori? Difficilmente: questa profondità cromatica è quella usata dal 99,9% dei monitor in circolazione, eppure riesci a vedere benissimo le foto delle vacanze, che hanno un aspetto, be, fotografico, cioè estremamente vicino alla realtà. Perchè allora sbattere la testa per implementare nei chip grafici la precisione floating point, quando questa costa un botto di transistors? La risposta non è tanto nella quantità di colori disponibili (ricorda: per la stragrande maggioranza dei casi bastano quelli ottenibili dai classici 32 bit), ma nella _precisione nel selezionarli_ nell'appplicare i vari effetti (illuminazione, multitexturing, ecc). Per fare un esempio, guarda qui questa scena renderizzata da una Radeon 8500 (DX 8.1):  La scena è molto bella, ma palesemente non ha un aspetto fotorealistico. In confronto, la prima scena che ho postato sopra (quella delle palline colorate) che gira su R300, ha un aspetto infinitamente più realistico. Ciao. :) |

Quote:

Ciao. :) |

Quote:

|

Quote:

|

Quote:

Caspita, se penso a quello che hanno tirato fuori da quel chip (DX6 praticamente, dato che il T&L era gestito dall'emotion engine, giusto?) e lo paragono ai giochi PC dell'epoca, mi sento male! :D Ciao. :) |

Quote:

|

| Tutti gli orari sono GMT +1. Ora sono le: 07:45. |

Powered by vBulletin® Version 3.6.4

Copyright ©2000 - 2024, Jelsoft Enterprises Ltd.

Hardware Upgrade S.r.l.