|

Alla fine conta solo una cosa, la maggioranza dei gamers non può accedere al dlss mentre al fsr si.

|

Doppio

|

Quote:

|

Era "pre-baked" (è il termine corretto :D ) nelle lightmap :)

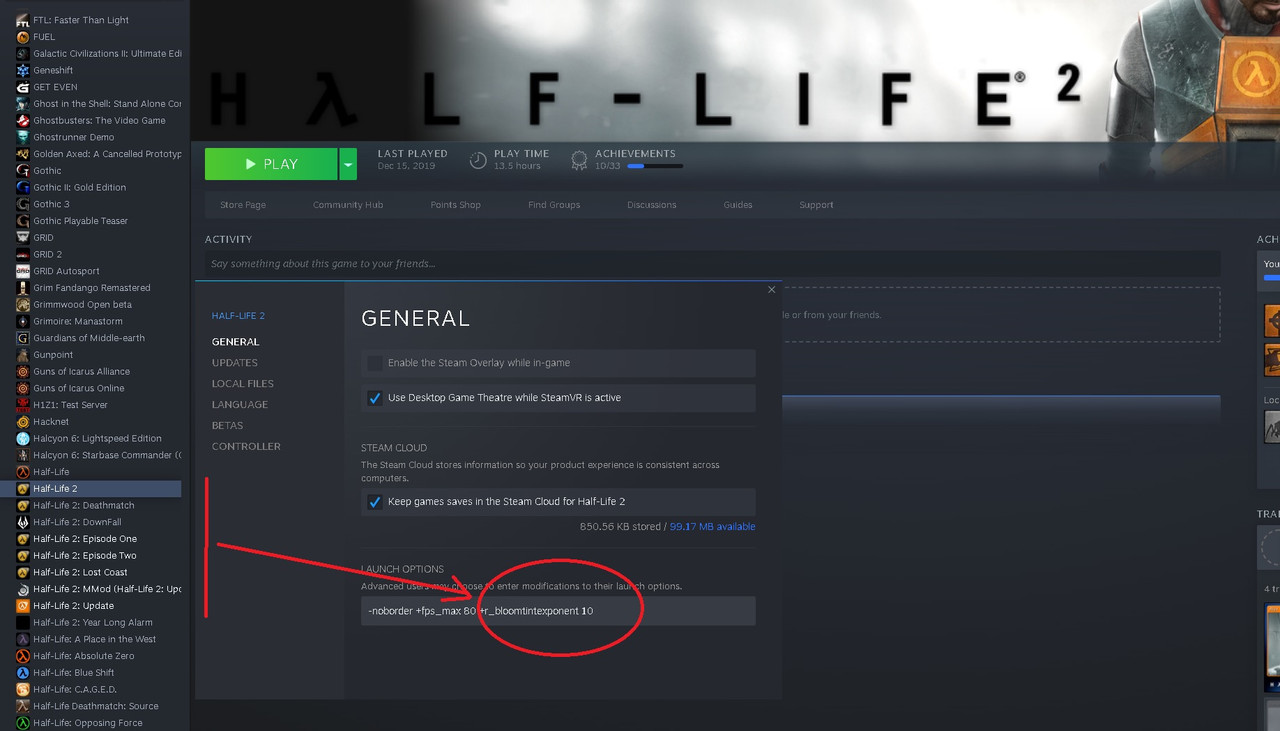

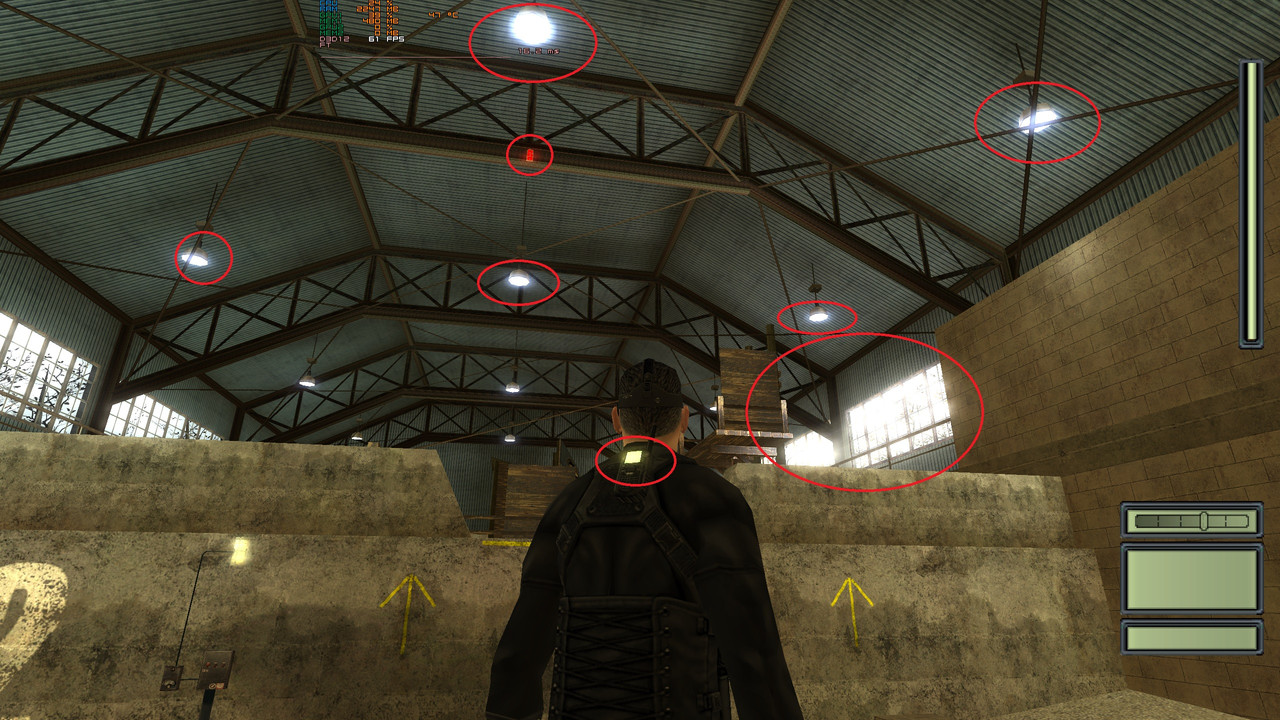

Lo so bene eh, ho iniziato ad interessarmi di queste cose nel 1997. Marketing era chiamarlo "HDR" per differenziarlo dalle implementazioni del Bloom precedenti fatte in D3D8 (vedi Deus Ex Invisible War e Thief Deadly Shadows, ma anche Splinter Cell che non ha solo le ombre dinamiche ma pure il bloom in *L*DR) Non è che basti fare Bloom+Eye Adaptation e Tone Mapping per avere un HDR percepibile come tale solo perchè calcolato in virgola mobile "C'abbiamo l'intervallo grande !!111 Quindi non vi stiamo mentendo!!1111" Serve appunto un monitor con una dinamica adeguata (che ai tempi NON c'era domesticamente parlando), altrimenti ti ritrovi a valle quello che a tutti gli effetti è un COMPRESSORE di dinamica - della luminanza - e per evitarne overshoot (bianchi abbaglianti che INONDANO la scena, letteralmente strabordando la relativa fonte di luce a cui sono legati) devi fare così:  |

Off topic:

Per chi è interessato qui è spiegato in modo semplice la questione dell'HDR e dei suoi usi :D https://gamedev.stackexchange.com/qu...ont-be-applied Non basta(va) avere l'engine con la pipeline di rendering in HDR, serve un monitor HDR anche per evitare un Tone Mapping troppo aggressivo per tornare nel range di luminosità riproducibile dal monitor stesso! Altrimenti, non avendo un monitor HDR, se non usate il Tone Mapping vi ritrovate la scena " bleachata" - letteralmente candeggiata :D - come capitava appunto in HL2 o Oblivion (le rovine Ayleid a mezzogiorno :asd: ) e l'unica soluzione subottimale era - anzi, è - agire sulla matematica degli shader come vedete nel mio screenshot di sopra. Oblivion (la NEXTGEN!!1111 - era la prima volta che veniva usata questa espressione terrificante che tutt'oggi ci perseguita :O ), per non dimenticare: https://steamuserimages-a.akamaihd.n...letterbox=true :asd: Io considero Splinter Cell come il *PRIMO* gioco - novembre 2002, 19 anni fa! - con estesa implemetazione del Bloom prima dell'era dell'HDR. L'accumulo (dinamico) di luce è evidente intorno alle fonti di luce :p (anche perchè attualmente per emulare il funzionamento del GeForce 3/4 e della GPU della prima XBox servono wrapper che mostrano perfettamente i limiti tecnici dell'epoca, infatti l'emulazione NON può essere perfetta cosa che si traduce in artefatti dell'effetto - l'aureola di luce viene squadrettata, lo vedete bene in movimento)  |

Quote:

Normalissima Radeon RX 570 - 1250 / 1950  Ah, dimenticavo: LUMEN è spettacolare per la Global Illumination senza rayracing, perlomeno ai livelli dello SVOGI del CryEngine (io dico sopra) |

Quote:

E' in AREA, 10% bidimensionalmente parlando :) (832x468) [/Script/Engine.GameUserSettings] bUseVSync=False bUseDynamicResolution=False ResolutionSizeX=2560 ResolutionSizeY=1440 LastUserConfirmedResolutionSizeX=2560 LastUserConfirmedResolutionSizeY=1440 WindowPosX=-1 WindowPosY=-1 FullscreenMode=1 LastConfirmedFullscreenMode=1 PreferredFullscreenMode=1 Version=5 AudioQualityLevel=0 LastConfirmedAudioQualityLevel=0 FrameRateLimit=0.000000 DesiredScreenWidth=832 bUseDesiredScreenHeight=False DesiredScreenHeight=468 LastUserConfirmedDesiredScreenWidth=832 LastUserConfirmedDesiredScreenHeight=468 LastRecommendedScreenWidth=-1.000000 LastRecommendedScreenHeight=-1.000000 LastCPUBenchmarkResult=-1.000000 LastGPUBenchmarkResult=-1.000000 LastGPUBenchmarkMultiplier=1.000000 bUseHDRDisplayOutput=False HDRDisplayOutputNits=1000 Ecco qui tutti i vari step da 2560x1440 :) 100 (2560x1440)  75  50  25 (1280x720)  10  Che dire.....meglio non dire niente dato che non so nemmeno se posso postarle queste cose :D Gli FPS in relazione alla frazione in area li vedete comodamente nell'overlay di RTSS. A voi :O Se viene la polizia di Tim Sweeney a prendermi saluto ATTTUTTI :asd: |

Quote:

|

oh ragazzi questo non è il thread fidelityFX eh :asd:

comunque.. sto continuando a sperimentare undervolt, sono arrivato più o meno stabilmente a 960mv, dico più o meno perchè ho avuto UN crash in red dead 2 che sembrava proprio il tipico crash da undervolt (nessun errore e si torna a desktop), dopo di quello ho riprovato per un'oretta (e più) e non è ricapitato quindi ho provato a scendere ancora allo step successivo 950mv, mezzoretta di project cars e lì ho cominciato a notare (grazie per chi mi ci ha puntato, non lo avrei notato altrimenti) che ho cominciato a perdere una decina di mhz, niente per cui strapparsi i capelli ma quindi credo di essere arrivato al limite per il quale la telemetria della scheda comincia a boostare meno. è comunque un dato interessante ho letto l'articolo di igors lab che è arrivato a 900mv ma scendendo a 2130 effettivi circa per poi dare come buon compromesso OC 930mv per 2340 circa effettivi, ma spiega appunto che overcloccando la gpu si ottiene un incremento del voltaggio non desiderato nel mio caso vorrei lasciare la vga sui 2200/2250 circa effettivi quindi farò alcune prove per capire come arrivarci la domanda è: alzo la frequenza di quel poco con che voltaggio visto che si overvolta da sola? 930? 950? 970? farò delle prove per capire che voltaggio reale applica in questo momento (con 950 da pannello) e che voltaggio applica dopo con gli altri settaggi. ad ogni modo non è proprio chiarissimo il funzionamento di questa big navi :mbe: |

Quote:

https://www.tomshw.it/hardware/amd-f...lita-immagine/ |

Il buon Igor videogioca? Perché tramite il suo tool ho portato la 6900xt a 650mv e per minare va una bomba. Chiaramente in gioco si deve ritornare alti

|

Ma non erano 700mv il minimo?

|

Quote:

|

ma per una 6700xt reference cosa c'è da fare per ottimizzarla ???

tipo vedo 82° in cod warzone... overclock vale la pena? |

Quote:

Io ho abbassato sia tensione che frequenza massima :fagiano: |

Ciao, qualcuno può suggerirmi dei settings (senza OC) che facciano andare la mia 6900 al massimo e senza problemi?

Consumi e rumore non mi interessa ridurli. Tipo Min Freq e Max Freq... non capisco il senso della % minima che va da 0 a 500 mentre la massima solo fino a 119. In AMD il team che sviluppa i drivers si droga? Grazie |

Quote:

Io mi trovo molto bene con quelle impostazioni. |

Allora, mezzoretta di test NON DI STABILITA' con superposition giusto per capire come si comportano queste nuove schede variando frequenza e voltaggio, sto finalmente cominciando a capirci un po di più, tenete a mente che la mia 6800 default da pannello radeon è settata 2224mhz e 1025mv

il primo gruppo di test ho cominciato ad abbassare il voltaggio a step di 10 fino ad arrivare a 930, oltre non sono sceso: si nota come abbassando il voltaggio la telemetria toglie qualche mhz, niente di che ma è bene tenerlo a mente si parte quindi da effettivi 2200mhz 1025mv @188w per arrivare a 2170mhz 930mv @153w quindi ben 35w in meno perdendo soli 30mhz e ovviamente questo è il picco di efficienza della scheda dopodichè ho provato ad aumentare i mhz lasciando il voltaggio fisso a 930mv, si nota come ad ogni incremento fatto da pannello radeon si ha una scalarità perfetta con i mhz effettivi ma altresì che la telemetria per poter tenere stabile la scheda suppongo aumenti (non volutamente) il voltaggio, quindi ogni step +25mhz corrisponde un evidente aumento in mv, sono arrivato fino a effettivi 2300mhz 1018mv @194w tutto questo pur avendo da pannello lasciato 930mv cercando di capire come funziona questa telemetria o come volete chiamarla ho provato con 2275mhz e 2250mhz ad abbassare il voltaggio del pannello da 930 a 920mv ottenendo praticamente nessuna differenza sostanziale sul wattaggio segno che a meno di un certo valore la scheda non scende verificherò nei giorni a venire la stabilità di questi settaggi ma nel mio caso dove la potenza bruta è già fin troppa credo che opterò per uno dei settaggi intermedi tra quelli alta efficienza tipo effettivi 2225mhz 965mv @168w |

Quote:

Ho chiesto perché la percentuale ha valori a caso. Se non sai rispondere che scrivi a fare? |

| Tutti gli orari sono GMT +1. Ora sono le: 11:40. |

Powered by vBulletin® Version 3.6.4

Copyright ©2000 - 2024, Jelsoft Enterprises Ltd.

Hardware Upgrade S.r.l.