|

Quote:

Mi sembra un metodo intelligente e simile ai concetti di compressione video che si applicano in fase di codifica della compressione... A me sinceramente non dispiace affatto come concetto. Ti becchi il max dettaglio sullo statico ma se c'è una scena con movimento elevato dove è impossibile percepire differenze di dettaglio va ad incrementare le prestazioni. Mi ricordano tanto le QMF che usavo per comprimere i video in Xvid o x264:D :D :D :D |

Quote:

Radeon Boost (che uso con Borderlands 3) semplicemente fa downsampling e piuttosto brutale se non c'è un filtro temporale (TAA/TXAA o Motion Blur) a "nascondere" gli artefatti. Davvero, non confondete VSR con un downsampling solo perchè in Metro hanno messo lo stesso nome :asd: VSR è una cosa estremamente più complessa e non per niente il supporto va oltre alle specifiche delle DX 12.1 |

Quote:

Il paragone migliore è con h265 cmq. E' qualcosa che riguarda l'aggiornamento dei pixel della scena più che il loro numero nel frame (numero di pixel aggiornati vs numero di pixel totali del frame). E come dicevo richiede GPU con supporto alla tecnologia che va oltre le specifiche 12.1, per questo quello di Metro (non EE) non c'entrava nulla ma semplicemente usarono lo stesso nome per del normalissimo downsampling in-engine. |

Quote:

|

Non ci stiamo capendo.

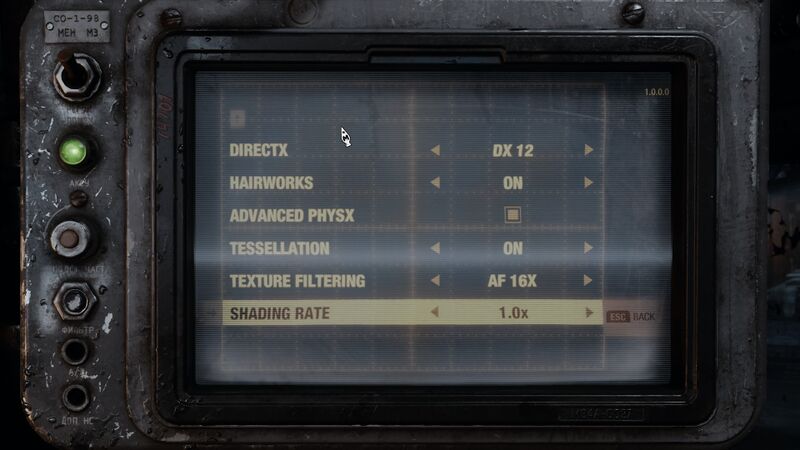

VSR è 2 cose: *Virtual Super Resolution (che è downscaling a livello del dialogo GPU-monitor) *Variable Shader Rate che fa parte delle DX come specifica Il secondo lo puoi chiamare anche Variable Rate Shading che è la stessissima cosa di quello che intendevo io. Il primo è banale dowsampling appunto e nel 4A Engine di Metro hanno usato 2) per chiamare 1) - dovete prendervela con loro, mica con me :p Qui c'è tutta la spiegazione (più di un anno fa): https://www.hwupgrade.it/articoli/sk...vrs_index.html |

Quote:

Uno appunto è portato a pensare che sia il VRS questo (V)SR in quanto c'è scritto "Shading Rate" ma in realtà era solo downsampling in-engine (cioè paradossalmente come il VSR appunto, magari era una trollata voluta) Nella EE invece c'è la versione "giusta", VRS/VSR autentico inteso come "shading rate", non come "super resolution" :p Io rispondevo a chi ha fatto l'esempio di "Metro non EE" infatti, non sapendo che in realtà era banale downsampling pur avendo la dicitura "shading rate". |

https://gpuopen.com/fsr-announce/

Fixed and arbitrary scaling supported. :asd: :asd: :asd: Ci sarà lo sliderone :sofico: A meno che AMD abbia assunto dei geni della matematica e dell'ottimizzazione (sarà eseguito come shader, dai, c'è solo da capire a che punto della pipeline di rendering per questo necessita di supporto in-engine anche se facilmente integrabile) la vedo dura avere un'ottima qualità dell'immagine E scaling arbitrario insieme :stordita: :fagiano: 2 giorni dopo lo vedrete come shader applicabile via reshade, artefatti da posizione nella pipeline a parte. Col CAS è successo così :D |

ma il Radeon Boost come funziona???

c'entra qualcosa con FSR? |

Quote:

|

Quote:

Fa l'opposto dell'upscaling, parte da una risoluzione alta e la riduce quando c'è meno possibilità di accorgersi della riduzione conseguente di dettaglio, cioè durante movimenti rotatorii. Tecnologia esistente già nell'Unreal Engine 1.5 (Deus Ex Invisible War / Thief Deadly Shadows) creata in funzione dei limiti della prima XBOX, operante a livello del viewport. E' visivamente accettabile SOLO con T(X)AA attivo o meglio ancora il motion blur. O entrambi. Cosa che ne porta l'interesse per il PCGamer medio a.....0. A meno che uno giochi in 4K su monitor 24 pollici. Col 24 QHD si nota ahimè ancora troppo......(a quel punto preferiscon l'integer scaling per uniformità di segnale e conservazione del dettaglio, se poi alla fine della catena devo proprio metterci il T(X)AA - ad esempio in Breakpoint non c'è altra alternativa per l'AA ) |

Quote:

E dalla sensibilità personale, un po' come per il ricampionamento audio (non è detto che la tua sensibilità personale vada di pari passo con i criteri matematici, c'è di mezzo il training sensoriale che ti porta ad apprezzare magari cose "matematicamente errate" ma che il tuo cervello via occhio/orecchio impara ad apprezzare e che lo soddisfano - c'è gente che abituata al Nearest-neighbor filtering degli anni '90 odia ancora oggi bilinear, trilinear e anisotropic filtering perchè "E' TUTTO SMARMELLATO!!1111" cit. l'utente di prima :D :D :D ). |

Quote:

quindi io con la 6700xt e un 27" 1440p mi conviene? |

Quote:

Quote:

Quote:

Francamente lo consiglio solo a chi ha un 24" 4K. Senza considerare che ad esempio nei giochi di guida, RPG/RTS top-down è perfettamente inapplicabile. Ma non vedo il problema, riguarda solo 4 giochi in croce. Spera piuttosto per l'FSR. Magari AMD fa davvero la magia......non dico che matematicamente sia impossibile, in sostanza di tratta di "vettorializzare" la coda di frame in output.....certo che insospettisce molto il fatto che venga dichiarato "spatial upscaling" allora, come ad intendere che non venga presa in considerazione la correlazione fra un frame e l'altro. E' una dimensione decisamente utile (vedi risultati che ho postato sopra da Q2 RTX). |

Quote:

Bi/Tri linear sono filtri preistorici e non implementano niente di particolarmente innovativo per l'upscaling. Per ricostruire in maniera sensata un'immagine serve sempre partire da info aggiuntive (come ad esempio i motion vector ) , se queste non sono presenti è.impossibile fare qualcosa di decente probabilmente... |

Quote:

|

Quote:

Anche per l'upscaling c'è da considerare la sensibilità individuale da "abitudine" (mi pareva chiara l'analogia e che fosse appunto una analogia). |

Quote:

E infatti in Q2 RTX te ne accorgi un po', ma niente di drammatico. Ho visto in certi engine lag immensamente più paurose (quelle del Creation Engine di Bethesda sono proverbiali :D ) senza alcuna necessità (motivata) che ci fossero! L'upscaling invece è una motivazione più che sana, dato che QHD e 4K costano ancora molto in termini di performance e ci stiamo letteralmente passando in 2 generazioni di GPU.....con tanto di penuria delle stesse mentre abbiamo monitor QHD e con un bel po' di FIUCIOR interessanti :asd: a 150 euro. |

Su reddit un utente ha scaricato il video in 4k alla massima qualità dell'FSR, e salvato dei PNG e zoomato, ecco il risultato:

Codice:

www reddit com /r/Amd/comments/nqd0lz/fidelityfx_super_resolution_ultra_quality/ |

Quote:

per me sarà una vittoria arrivare open source a quello che fu il DLSS1.0 per poi essere sviluppato via con gli anni e che non richieda unità dedicate, che come fatto vedere potrà funzionare sia su APU che su schede vecchie nvidia che adesso sono tagliate fuori aspettate di metterci le mani sopra poi shitstormate a piacere :p |

Dal punto di vista dei possibili miglioramenti sono meno ottimistico.

Mentre da una parte il DLSS aveva ampi margini di miglioramento, sia come metodologia di training che come sviluppo della feature in se, qua stiamo parlando di un upscaler spaziale che è basato su un algoritmo sul quale non vedo molto margine di manovra. Diciamo che il risultato del livello qualitativo ultra non è nemmeno così male. E' il livello quality che blurra davvero in maniera aggressiva. |

Quote:

|

Quote:

Se prendete il CAS e lo paragonate allo sharpening in-engine di Deus Ex Mankind Divided nel 2016 (per compensare il blurring da TAA) capite che alla fine ci lamentiamo davvero un po' troppo :p |

Ma almeno sto banalissimo upscaler è dos 5 compatibile come il resizable bar?

Quote:

Tanto per la cronaca, il Virtual Super Resolution serve ad andare oltre la risoluzione nativa del monitor stile super sampling, mentre il VARIABLE RATE SHADING è la feature delle dx12 ultimate per avere un rate diverso in punti della scena, tecnica applicata anche in dirt 5, che applicata di recente al radeon boost pemette di non peggiorare l'immagine entrando in azione in maniera molto soft e garantendo comunque un discreto aumento di perf, ti ho postato anche un video |

Oddio mi gira la testa, non sono più abituato a discutere di cose simili, ormai sono diventato esperto di programmazione bot, gestione dello stress da acquisto compulsivo inapplicato e delazioni su sospetti miner da rinchiudere in galera e buttare la chiave....

|

Quote:

Ho solo fatto notare che i 4A hanno chiamato 1) con 2) in Metro Exodus *NON* EE :asd: Nell' EE è tutto corretto, c'è VRS ed è appunto quella che entrambi conosciamo come tale da specifica DX12. L'intelligenza sta nel crearli i pixel in più, in modo che siano appropriati al contesto. |

Quote:

|

Quote:

Quote:

sarebbe interessante capire quelli che usano DLSS con quale impostazione sono soliti giocare, se con quality o bilanciato o performance |

Quote:

Il denoising senza appoggio a reti neurali è una cosa assurda computazionalmente parlando: praticamente è lui il macigno, mica il raytracing (beam tracing) in sè. |

Quote:

Quindi cosa? Ho solo fatto notare l'errore in Metro NON EE a riguardo di "variable shading" che si trova nel menù e NON è il VRS ma appunto downsampling. Il DLSS 2.0 di intelligente ha che i pixel li inferisce. |

Quote:

Nessuno shitstorm, ho una 6900XT qui imballata che aspetta il 22 giugno per essere aperta o rivenduta :) Dispiace vedere la semplicità dell'implementazione AMD, tutto qui. Evidenziavo solo che anche in ultra quality, il blur regna sovrano e la qualità è molto lontana, purtroppo, dal concorrente diretto. |

Quote:

Mentre Nvidia pubblicizza che il denoising è fatto in modo intelligente andando a ridurre il carico mantenendo la massima qualità. |

Quote:

|

Quote:

Va detto che negli ultimi giochi anche il bilanciato e a volte il performance rendono moooolto vicino alla nativa. In Metro Exodus EE dicevano appunto che il Performance rende molto vicino al nativo. In altri l'unica che rende bene è quality e già a balanced si vede il blur... |

Quote:

Ma esattamente dove c'è scritto che per fare tutto ci vuole l'ai per forza, ci sono paper (non di nvidia) e pubblicazioni (non di nvidia)? perché a questo punto pure per fare le addizioni ci vuole l'ai, per il mouse, per la stampante, ecc...come fa a stampare il foglio se non sa che dentro ci sono i fogli? Rivoluzione! |

Quote:

Sono cose che io facevo su Amiga ma con 1 frame al quarto d'ora |

Quote:

Motion vector. Che AMD non usa. Frame buffers: che AMD non usa. Dopodiché, è matematicamente dimostrato che le reti neurali linearizzato algoritmi di fitting che altrimenti possono essere complessi e sicuramente non lineari: terzo quarto quinto ordine etc... Quindi si, le reti neurali, alla base dell'AI, sono sicuramente il metodo più efficiente per implementare un algoritmo di fitting (più efficiente significa più FPS). Ed AMD non usa neanche queste oggi. Quindi il preoblema.non è solo l'AI, sono tutta una serie di scelte assurde che sono state fatte. |

Il brevetto a cui fa riferimento l'FSR parla di inference, quindi utilizzerà calcoli di AI. Quello che non fa (per il momento) è utilizzare i motion vectors, come dichiarato da AMD e comunque anche nel brevetto non vi si fa riferimento. Detto ciò, non è detto che revisioni successive non li implementino, o che FSR non possa essere accoppiato ad altri metodi di ricostruzione dell'immagine.

|

Quote:

|

Quote:

Il brevetto è citato qui: https://forums.anandtech.com/threads...n-gsr.2593747/ e come si vede si cita l'utilizzo di inferencing in un ambiente "wholly learned". Non solo, ma si fa già riferimento alle reti neurali nell'abstract (ribadendo che un minimo di utilizzo di reti neurali esiste già nelle tecniche di upscaling tradizionali). |

| Tutti gli orari sono GMT +1. Ora sono le: 17:59. |

Powered by vBulletin® Version 3.6.4

Copyright ©2000 - 2024, Jelsoft Enterprises Ltd.

Hardware Upgrade S.r.l.