|

Quote:

|

Ahimè, sta per finire la pacchia: Autodesk Remake funzionerà solo fino al 30 novembre, dopodichè verrà disabilitata la funzione di elaborazione su cloud e il programma verrà sostituito da Autodesk Recap Photo, a pagamento, a partire da 40 dollari al mese!!!

Recap Photo funzionerà esclusivamente online... il che lascia supporre che probabilmente sarà comunque possibile continuare a usare Remake offline; ergo, sbrigatevi a scaricarlo! (sempre che il download sia ancora disponibile!) Ma tenete presente che i requisiti minimi di sistema sono 16 GB di RAM e una scheda video nVidia. Comunque esiste già anche il freeware 3df Zephyr, e anche per cellulare stanno comparendo diverse app. https://knowledge.autodesk.com/suppo...Questions.html |

Quote:

|

Autodesk Remake ci ha lasciato, così ho iniziato a fare esperimenti con 3DF Zephyr, di cui è ancora possibile utilizzare la versione gratuita, che accetta solo un massimo di 50 foto (come la ex versione free di ReMake) e funziona offline.

I risultati non sono male: pur avendo impostato la risoluzione minima, per non sovraccaricare il mio povero dual core con soli 4 GB (ma gli sto preparando un regalino :) ), ho ottenuto un modello 3d paragonabile a quello ottenuto con ReMake, usando la stessa base di foto: circa 50, di cui 3DF ne ha scartate 15 (per motivi che non so). Questa volta, invece di fare un'elaborazione unica, ho proceduto per step, per non perdere il lavoro in caso di crash: nuvola di punti approssimativa ("sparse"), nuvola precisa ("dense"), mesh e infine mesh con texture. Interessante il fatto che l'elaborazione stavolta sia durata solo un paio d'ore invece che 3 giorni come la volta scorsa (quando però avevo impostato la risoluzione massima). Fontana "Tevere", a Roma, gruppo "Quattro fontane": Versione Remake Versione 3DF Intanto ho scoperto anche un software open e multipiattaforma, ma devo ancora provarlo: si chiama Regard3D. La parola chiave da ricercare è, oltre a "fotogrammetria automatica" e cose simili, anche "structure from motion", "SFM". Tempo fa avevo trovato un programma cercando in questa categoria, e ne trovai uno che dava come risultato una manciata di puntini e i punti di osservazione della telecamera, e l'ho scartato come "inutile", ma poi, facendo la suddetta prova con 3DF, ho scoperto che al primo passaggio la nuvola di punti "sparse" creata è molto simile a quella prodotta dal programma di SFM! Quindi forse avevo solo interrotto l'elaborazione troppo presto... o forse il SW era ancora troppo acerbo, non so. Da indagare. Un altro studio che ho fatto è la possibilità di usare foto a 360° per fare ricostruzioni 3d. Oltre a "ottenere" che un tizio creasse (per me?!?) uno script per Imagemagick che estrae singole immagini piane da una sferica , ho anche trovato una ricerca (italiana) che spiega come sia effettivamente possibile ricostruire l'interno di una stanza usando una decina di foto a 360° con pochissimo sforzo dell'utente: https://www.int-arch-photogramm-remo...W3-85-2017.pdf |

Quote:

Quote:

|

Ho dato in pasto a Regard3d il solito pacco di 50 foto della fontana Tevere.

Si è bloccato il PC, non funziona manco il mouse, e dopo 3 ore sta ancora al 30% dell'elaborazione.... :( Purtroppo non mi ha dato la possibilità di scegliere la risoluzione desiderata o altre opzioni... ha preso e ha iniziato a masticare le foto appena gliele ho date. Vediamo un po' se esce fuori qualcosa di buono o se sto solo usando il PC come stufetta! :rolleyes: Stavo considerando la potenza di calcolo necessaria per la fotogrammetria automatica: credo che per 50 foto servano 50^2 confronti per trovare punti in comune tra tutte le foto, quindi 2500 confronti; però le istruzioni di Regard3d suggeriscono di usare da 50 a 200 foto... cioè da 2500 a 40.000 confronti!! :eek: Urge una scheda grafica decente! Ho letto che per la fotogrammetria è utile che la scheda disponga dalla tecnologia CUDA a elaborazione parallela, che sarebbe "tipica" di nVidia (addirittura, Autodesk Remake in locale funziona SOLO con schede nVidia, anche se non parla esplicitamente di questo CUDA). E' interessante anche soffermarsi a studiare i modelli 3d risultanti da un'elaborazione con poche foto: ci si rende conto di come il nostro cervello "inventi" di sana pianta "il retro" degli oggetti solidi che vede, mentre nei modelli 3d questo "retro", cioè la parte eventualmente non coperta dalle foto, appare piatto, grigio e senza texture, causa totale mancanza di immaginazione da parte del computer. Per esempio, se guardo una colonna, so benissimo che è cilindrica, senza bisogno di girargli intorno; ma se faccio 50 foto a una colonna senza però girargli intorno.... il computer, invece di una colonna, tirerà fuori uno sgorbio con un lato perfettamente tondo! :doh: Per inciso, questa è anche la "caratteristica" più sfruttata da maghi e prestigiatori per "farci fessi": sanno che il nostro cervello immagina le zone che non vede, e ne approfittano per far succedere di tutto in quelle zone! |

Qualche link da esaminare per la tecnologia "structure from motion":

https://dronemapper.com/software_downloads https://publiclab.org/notes/nedhorni...ructure-motion https://forum.openrov.com/t/structur...-for-free/4974 http://ccwu.me/vsfm/#demo |

Quote:

Quote:

... Quote:

prendi un'auto appena uscita, se la vedi solo da davanti non hai la + pallida idea di dove sta la targa dietro :p Quote:

|

Quote:

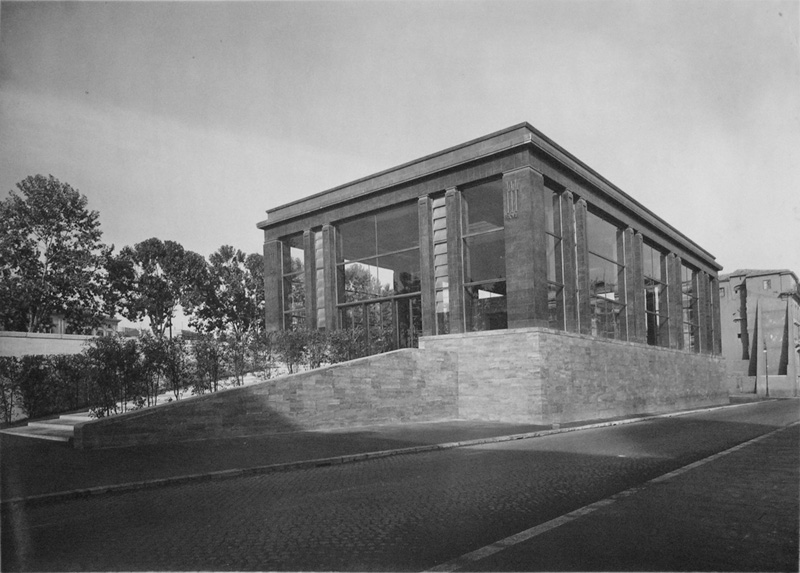

E a proposito di "cose quasi magiche" e "intuizione dall'esperienza", ho scovato un algoritmo interessante (anche se OT...): permette al computer di ricostruire i colori di un'immagine in bianco e nero "deducendolo" dalle texture dell'immagine e dalla sua "esperienza" in merito a colori e texture. Chissà se un giorno riusciranno a inventare un algoritmo del genere per gli oggetti invece che per i colori! Ecco un'applicazione di questo incredibile algoritmo, che a volte ha del miracoloso: http://demos.algorithmia.com/colorize-photos/ Mi ha per esempio permesso di dirimere la diatriba tra "teca bianca" e "teca rossa" che sollevai tempo fa nel thread: l'algoritmo ha riconosciuto come "rosso" il materiale della vecchia teca! (cosa poi confermata da alcuni documenti storici: era finto porfido rosso) Il risultato con questa immagine è strabiliante!   Considerate che un'immagine come questa probabilmente non può esistere nella realtà, visto che la pellicola a colori è arrivata in italia negli anni '50 ma la teca fu verniciata di bianco proprio negli anni '50, quindi probabilmente non esistono foto a colori della versione originale rossa. |

sembra quelle cartoline di molti anni fa in cui venivano colorate le foto in b/n :D

|

Interessante, ancora una volta il SW open si rivela migliore di quello che costa fior di quattrini: Regard3d mi comunica che la ricerca dei punti in comune tra le foto ha richiesto 5 ore e 48 minuti, e che i punti in comune tra le varie foto variano tra 6788 e 38956 (mai letta nessuna statistica, nè in Remake nè in 3DF).

La fase successiva è la "triangolazione" (vedi tutorial ufficiale): ha richiesto solo 4 minuti e 12 secondi! Il risultato è che sono state scartate solo 2 foto su 59 e sono stati trovati 80672 punti 3d (3DF ne aveva scartate 15). Per la fase successiva, la "densificazione", ho impostato inizialmente parametri un po' riduttivi, giusto per fare una prova veloce: scarto delle immagini meno utili (flag "use visibility informations") e "Livello 3" (qualunque cosa significhi; il tutorial dice che più è alto, più l'elaborazione è veloce). Tempo impiegato: 8m 12s L'ultima fase è l'unione dei vari punti tramite superfici interpolate, per creare il "guscio" (mesh o surface) finale; una prima passata la faccio col metodo della colorazione dei soli vertici, più rapida: 39 secondi. Il metodo delle texture impiega invece 25 minuti e dà origine a un file così grosso (75MB) e complicato che non riesco a visualizzarlo nè in Regard3d nè in altri programmi! Invece, restando sul metodo della colorazione dei soli vertici ma impostando Depth diverse, l'elaborazione resta sempre intorno al minuto. Find matches - fatto - 05h48m Triangulation - 00h 4m 12s Densification - 00h 8m 12s Surface generation - vertici: 1 minuto Surface generation - texture: 25 minuti Delle 59 foto, 3 le ho scattate da 10 metri di distanza (per avere una panoramica), 20 le ho scattate da 20-30 cm di distanza con flash (per riprendere il particolare della Lupa con Romolo e Remo, in basso a destra, che stanno nascosti in un anfratto), mentre tutte le altre da circa 50cm-1metro. La parte alta della scultura è irraggiungibile, arrivando a 4-5 metri di altezza. Non sono ancora riuscito a esportare da Regard3d in formato OBJ, l'esportazione si blocca; riesco a esportare solo in PLY: 150 MB di file! Compressi diventano 40MB. Però purtroppo non c'è texture. Ho caricato il risultato su Sketchfab: link Questa invece è una rassegna di screenshot delle varie elaborazioni: link |

Alla fine ho deciso di fare un regalino al mio vetusto PC:

16GB di RAM in più, e una scheda video Nvidia con 2 GB di DDR5 e 640 cores CUDA (una nVidia GTX 1050 Asus) . :) Spesa totale 250 euro (un PC con questa dotazione al momento costa 1500 euro...). Questi erano i precedenti tempi di elaborazione (con 4GB di RAM e senza scheda video dedicata): Quote:

Find matches - 1h 10m Triangulation - 4m Densification - 5m 23s Surface generation - vertici: 0m 17s Surface generation - texture: 6m 49s Però c'è un fatto strano: quando vado a ruotare la mesh finale risultante, il processo è lentisssssssimo! Vedo quando vengono disegnate le varie migliaia di poligoni ogni volta che muovo l'immagine anche di un solo grado! Sarà un problema di driver?!? Non li ho installati, ho solo infilato la scheda e acceso il PC... :stordita: |

La Ocutech360 sperimenta un algoritmo per estrapolare automaticamente un modello 3d da un filmato a 360°:

https://www.spar3d.com/news/related-...deo-3d-models/ |

|

Adesso addirittura abbiamo la ricostruzione Structure From Motion in tempo reale su dispositivi Android!

https://medium.com/super-ventures-bl...t-5223e6b3e79d Quote:

Pare sia una evoluzione/involuzione del sistema Tango, che si basa(va) su un sensore 3d tipo kinect... a quanto pare reso obsoleto dalla potenza di calcolo disponibile! Spero solo che il mio "misero" S7 sia all'altezza... ARKit è l'equivalente per IOS/Apple. ARCore fa addirittura una stima dell'illuminazione dei vari punti della stanza, e cambia l'illuminazione di un oggetto virtuale visualizzato sullo schermo a seconda del punto della stanza in cui virtualmente si trova! Nuovi termini da aggiungere al proprio vocaboloario tecnologico: SLAM - Simultaneous localization and mapping VSLAM - Visual Simultaneous localization and mapping VIO - Visual Inertial Odometry Qui però stiamo sconfinando nella realtà aumentata, dovel la SFM è solo un elemento secondario: viene usata "solo" per far capire al cellulare/computer com'è fatto l'ambiente 3d circostante, in modo da sovrapporgli realisticamente oggetti virtuali. |

Altra ricerca sulla fattibilità della ricostruzione di interni a partire da immagini sferiche o fisheye:

Immersive Photogrammetry in 3D Modelling GEOMATICS AND ENVIRONMENTAL ENGINEERING Volume 9 Number 2 2015 Karol Kwiatek*, Regina Tokarczyk** |

Si prospetta un futuro sempre più interessante per la preservazione virtuale dei monumenti, nonchè della loro visita virtuale:

Facebook/Oculus un mese fa ha annunciato un visore VR standalone, quindi svincolato dal PC , chiamato "Oculus go", a 200$, e HTC ha adesso annunciato il suo, che si chiamerà "HTC Vive Focus". La grossa novità per entrambi sta nel fatto di avere 6 gradi di libertà, cioè orientamento e posizione, cosa che un semplice cardboard o GearVR non hanno, essendo limitati a 3 DOF (solo rotazione). HTC Vive e Oculus Rift, i precedenti visori, oltre a richiedere connessione a PC richiedevano sensori esterni per monitorare e trackare il giocatore, mentre HTC Vive Focus e Oculus Go hanno tutto l'hardware a bordo. Questi due nuovi visori standalone vanno quindi ad aggiungersi al "cardboard+S8", reso possibile dall'SDK ArCore per android di cui parlavo un paio di post fa. Intanto ho scoperto anche lalibreria Vuforia per Android, che permette anche a cellulari che non supportano ancora ArCore di ricostruire l'ambiente 3d circostante senza fare ricorso a sensori esterni; mi pare di capire però che, almeno per ora, riesce a ricostruire solo un unico piano di appoggio (pavimento, tavolo), su cui è possibile collocare oggetti virtuali che non necessitano "marker". Però non ho ancora capito se devo per forza scrivere un'app per usarla o se c'è una qualche app che mi permette semplicemente di aggiungere i miei oggetti al mondo reale. Ho anche scoperto che Mizarlab (http://www.mizarlab.it/) è la società che sta "dietro" alle ricostruzioni virtuali, ma tramite semplici proiettori, dei fori di Augusto e Cesare a Roma, dell'Ara Pacis, delle tombe etrusche di Cerveteri. Spero che presto passino dal 2d al 3d, e di poter fare una passeggiata per i fori indossando un Oculus Go! |

SDK "Maxst" con versione gratuita per uso non commerciale, con potenzialità apparentemente simili a Vuforia:

https://developer.maxst.com/Pricing Anche qui c'è da capire come aggiungere un mio modello, se solo tramite app scritta in proprio o altro. |

Tutorial Vuforia (free) + Unity (free) per app con tracker a piacere e modello 3d a piacere:

https://www.youtube.com/watch?v=khavGQ7Dy3c |

Un altro importante contributo a questa nuova branca della scienza che è l'arechoricostruzione virtuale: le terme di caracalla!

Progetto "Caracalla IV dimensione", curato dal CNR. Per chi non lo sapesse, le terme di Caracalla sono fatte di "palazzoni" alti una cinquantina di metri! Oggi sono rimasti solo i muri e pochi tetti, ma all'epoca, come ora si potrà finalmente vedere invece di immaginare, c'erano marmi, mosaici e statue.  ...e io che ci sono andato appena due mesi fa! :doh: A saperlo prima! :muro: Dal sito ufficiale: Quote:

In altre parole, credo che sia un Samsung Gear VR. Quote:

QUESTO è il vero ingresso, presso il Largo Cavalieri di Colombo: link Solo che... è una strada a senso unico, non ci si può entrare dal viale Terme di Caracalla! Che è uno stradone a 6 corsie non "parcheggiabile"! Quindi l'unico modo sensato per arrivare qui in macchina e parcheggiare (gratuitamente) accanto alle terme è prendere Via Antonina da via Guido Baccelli, e fare tutta la discesa fino all'ingresso. |

| Tutti gli orari sono GMT +1. Ora sono le: 20:47. |

Powered by vBulletin® Version 3.6.4

Copyright ©2000 - 2024, Jelsoft Enterprises Ltd.

Hardware Upgrade S.r.l.