|

Quote:

|

Quote:

|

Quote:

EDIT: Per ora è a 45 gradi, effettivamente prima avevo appena spento AC Valhalla, magari era per quello. Lascio andare un 10 minuti per vedere quanto sale. Quote:

|

Quote:

|

Quote:

https://www.youtube.com/watch?v=jLVGL7aAYgY&t=1421s Techspot (frequenze 3080 reference) https://www.techspot.com/review/2144...adeon-6800-xt/ Hwupgrade non fa confronti diretti nelle review ma basta paragonare i dati di consumo (tralaltro fatti sullo stesso bench) per vedere come per il consmo scheda la 3080 sta perennemente oltre i 300W (intorno a 320-325) mentre la 6800XT sta sempre sotto https://www.hwupgrade.it/articoli/sk...ata_index.html https://www.hwupgrade.it/articoli/sk...ing_index.html computerbase https://www.computerbase.de/2020-11/...800-xt-test/4/ E queste sono tutte reference e si potrebbe anche continuare, ho preso le prime quattro che avevano una 3080FE nel raffronto... |

Quote:

Quote:

|

Quote:

|

|

Quote:

1) Ad oggi la 3080 è una scheda che reputo più bilanciata. Più bilanciata vuol dire che performa bene in raster (poco meno della 6800XT) e meglio in RT (da poco più a tanto di più a seconda degli scenari). Le differenze in raster tuttavia non cambiano la giocabilità (considerando che comunque parliamo di alti livelli in entrambi i casi). Consideriamo anche che a breve si avrà SAM anche su Nvidia. 2) la 6800XT ha parecchia VRAM in più : potrebbe tornare utile così come essere totalmente inutile, lo capiremo però in un range temporale forse troppo esteso (per non dire coincidente con le prossime generazioni). 3) consumano più o meno allo stesso modo, dai miei test i consumi a monte dellali differiscono di max 70W a sfavore della 3080 nel peggiore dei casi (ma ho una FE, la situazione peggiora se si fan confronti con custom OC) 4) a livello di maturità di drivers, la 3080 è avanti (ovviamente). Mi aspetto miglioramenti della 6800XT ma non molti lato RT, causa RA limitate a prescindere rispetto alle unità Nvidia alla loro 2 generazione. 5) io credo che ad oggi, usare RT in 2K/?4K rende quasi obbligatoria una tecnologia simil DLSS (che piaccia o meno). La sua assenza in casa AMD si sente. Probabilmente la vedremo anche in casa rossa prima della next gen, sono convinto. Ad oggi dunque (con una considerazione a 360 gradi) io reputo la 3080 un pelo sopra, a prezzi standard vale i 50 euro di differenza. Il tutto ovviamente imho |

Quote:

|

Quote:

Quote:

Quote:

|

Quote:

|

Quote:

|

Quote:

|

Quote:

https://www.guru3d.com/articles_page...review,25.html |

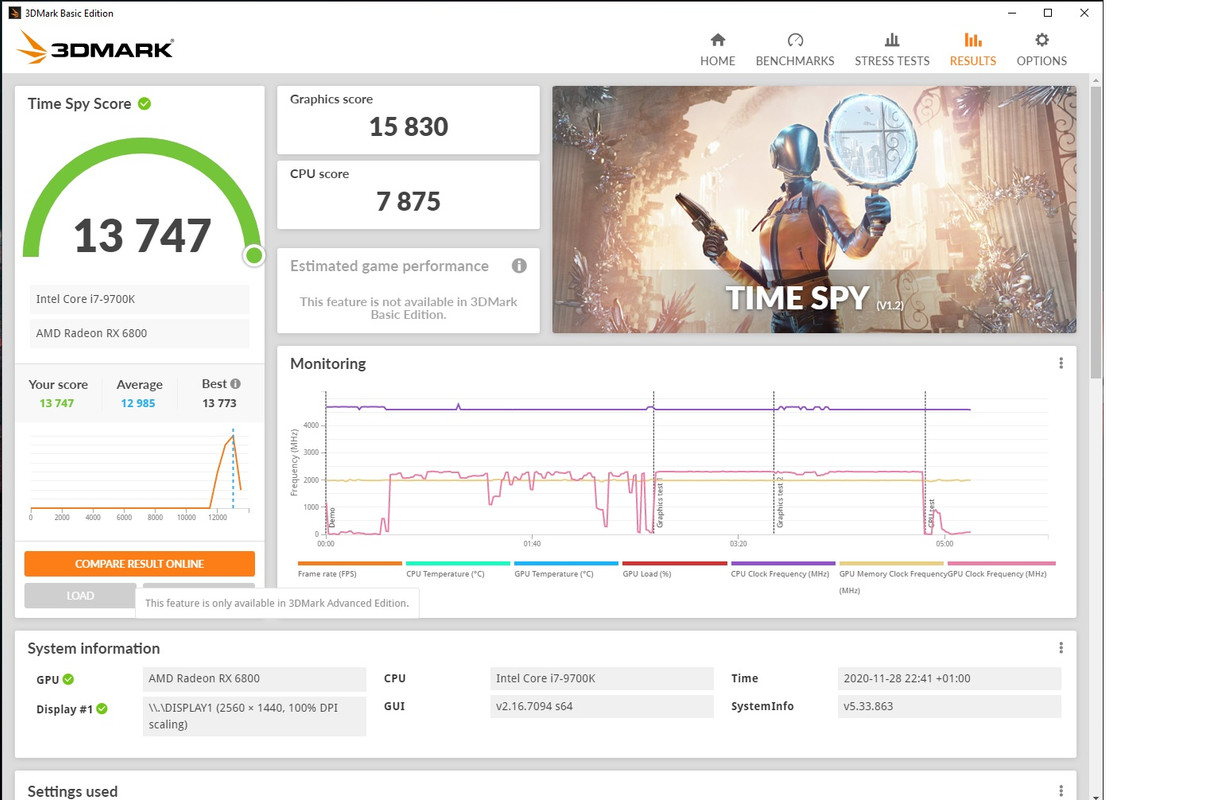

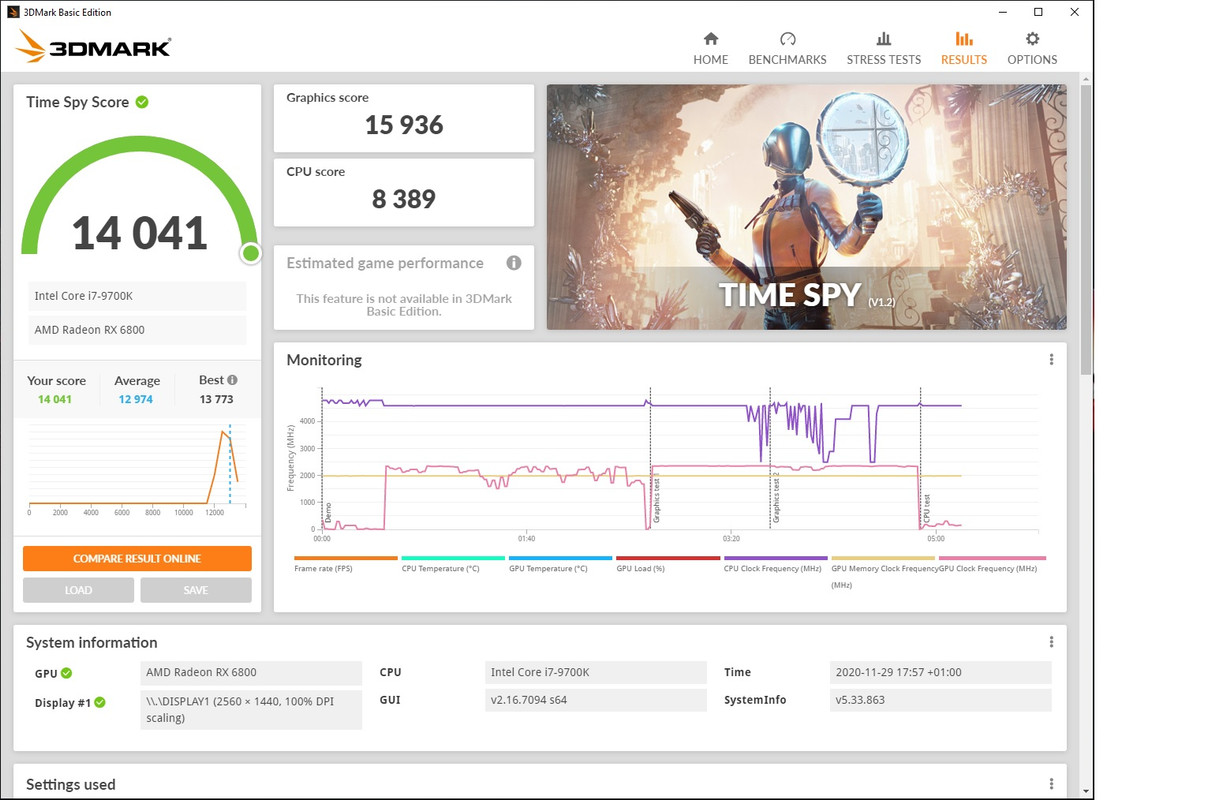

Questo è fatto con solo oc gpu a 2400 mhz, il precedente a 2350, procio a default |

Quote:

|

powercolor ha progettato una 6800 che dovrebbe essere messa in vendita addirittura ad un prezzo minore del MRSP di AMD quindi probabilmente costruttivamente inferiore alla reference.. segno che se si vuole fare.. si puà fare da vedere se mai arriverà in europa e a che prezzo |

Quote:

|

Quote:

|

Quote:

|

Quote:

|

Quote:

|

Quote:

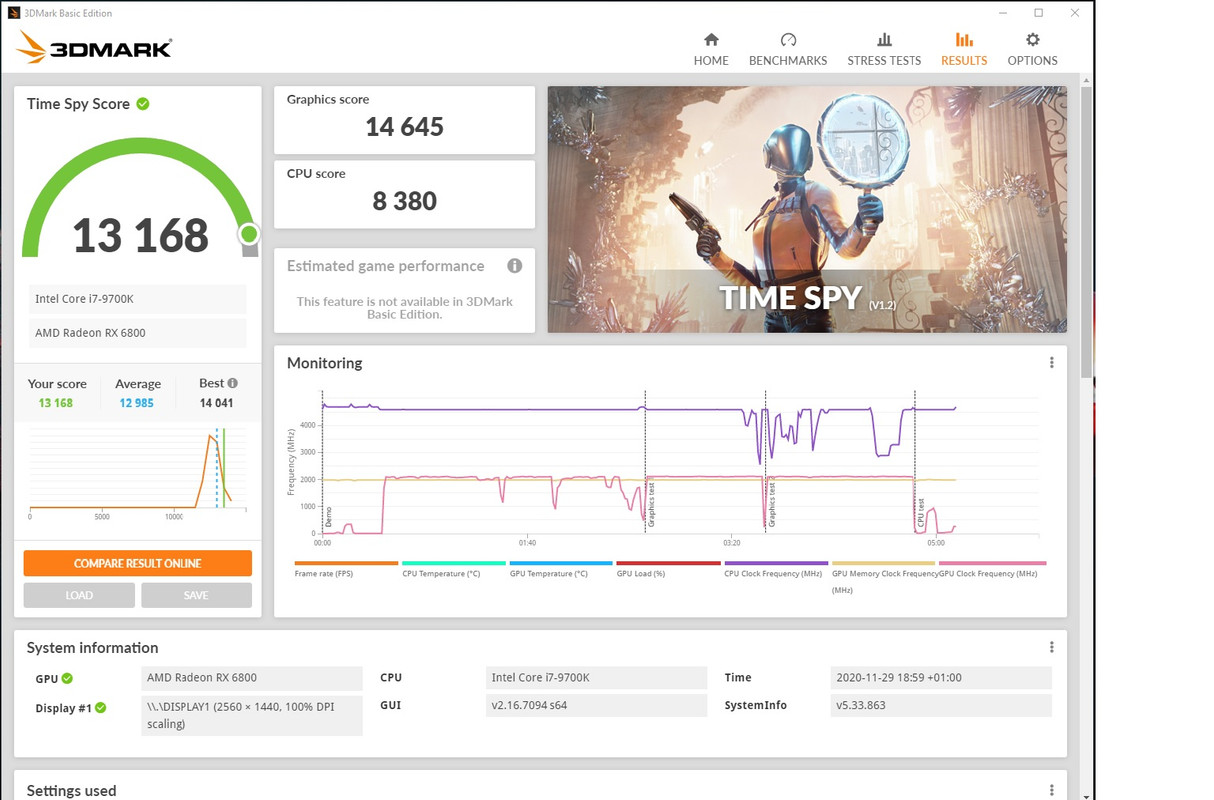

cpu, gpu, vram stock |

Quote:

|

Quote:

|

Quote:

|

Quote:

Boost Clock: 2650~2700 MHz Memory Clock: 17200 MHz Quindi se riuscissi a trovare una reference e metterla a liquido i 2700 se non sono sfigato dovrei superarli tranquillamente , ci vorranno magari 350W ma non sono un problema |

come volevasi dimostrare

https://www.pcgamingvault.com/2020/1...mTT1spwwDiFRQA addirittura preorder e consegne da febbraio |

Quote:

|

Quote:

|

Quote:

Però ognuno è libero di volere quell'effettino... Per me che mi butterò su 5950X e 6900XT (quindi SAM+Rage Mode) a 2560*1080 (o l'altro schermo da 37" a 1920*1080, entrambi in FreeSync), a me va benissimo senza RT. :D |

Quote:

Come diamine fai? Ho un 3900X a 4.250 su single core e una 2080Ti e con la stessa risoluzione arrivo a 55 fps di media. °_° |

Quote:

|

Quote:

|

Quote:

|

Quote:

|

Quote:

|

Non e' che state confondendo il rumore di attivazione del Radeon Chill con quello di sconnessione periferica...?

|

secondo me la devi vendere :D :D :D :D

|

| Tutti gli orari sono GMT +1. Ora sono le: 03:08. |

Powered by vBulletin® Version 3.6.4

Copyright ©2000 - 2024, Jelsoft Enterprises Ltd.

Hardware Upgrade S.r.l.